明敏 发自 凹非寺

谷歌和OpenAI又杠上了。

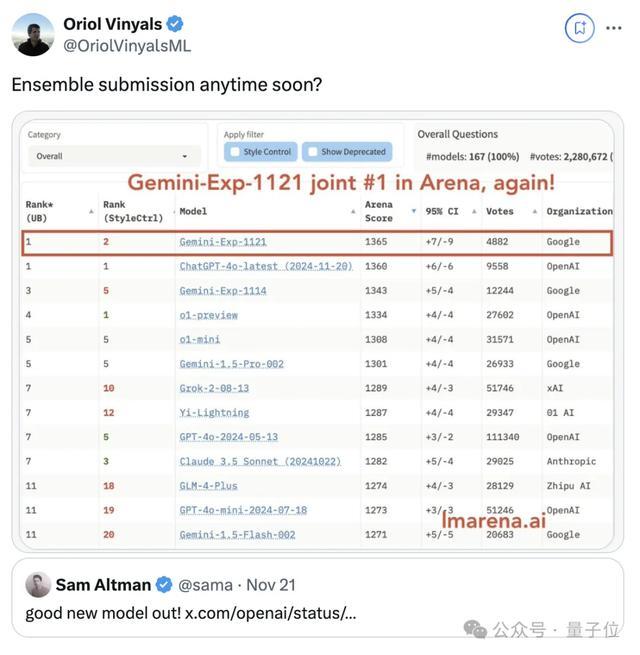

在新版GPT-4o刚登顶竞技榜后1天,立马发布最新试验版模型Gemini-Exp-1121夺回冠军宝座。

要知道,一周前上一版模型Gemini-Exp-1114才发布。

这怕不是拿准了OpenAI会来争擂台,故意留了一手。

这就是引诱OpenAI发新版GPT-4o,然后再用更好的模型来狙击它。

谷歌的研究人员们显然很得意。

谷歌DeepMind首席科学家Jack Rae,称这是一场有趣的后训练“闪电战”。暗示post-training的迭代速度要比预训练快得多。

DeepMind研究副总裁Oriol Vinyals还隔空发问奥特曼:最近还有提交计划吗?

火药味很足,也很自信啊。

所以“1121”有多强?来看具体性能。

代码/推理/视觉理解全提升

按照官方说法,Gemni-Exp-1121重点提升了三方面性能。

代码能力显著提升

更强推理能力

更强视觉理解能力

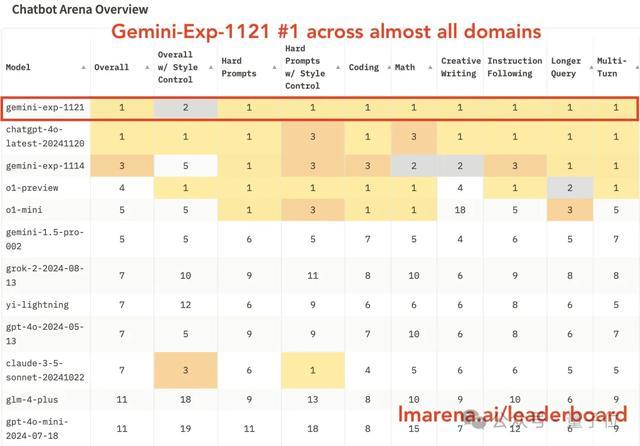

除了风格控制外,其他方面目前都位于第一。

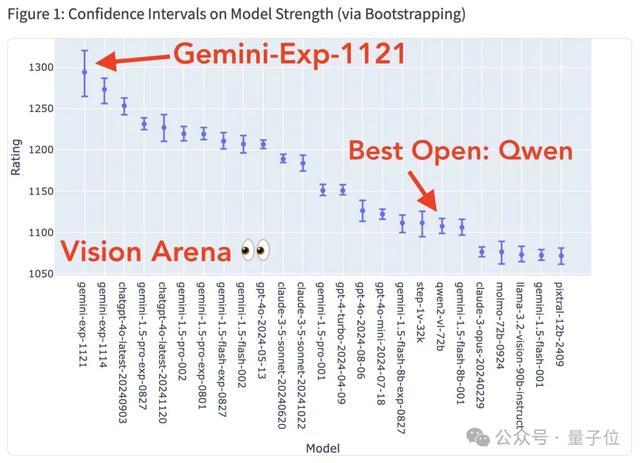

在视觉能力方面,Gemini-Exp-1121比上一版还有提升。

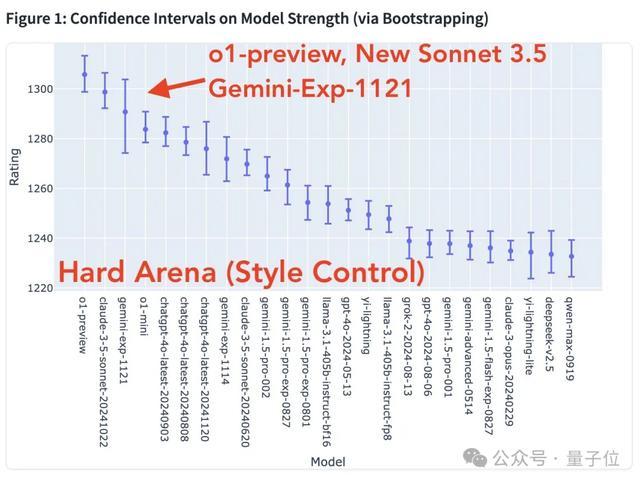

风格控制下的复杂提示词方面,Gemini-Exp-1121和o1-preview、New Sonnet 3.5水平相当。

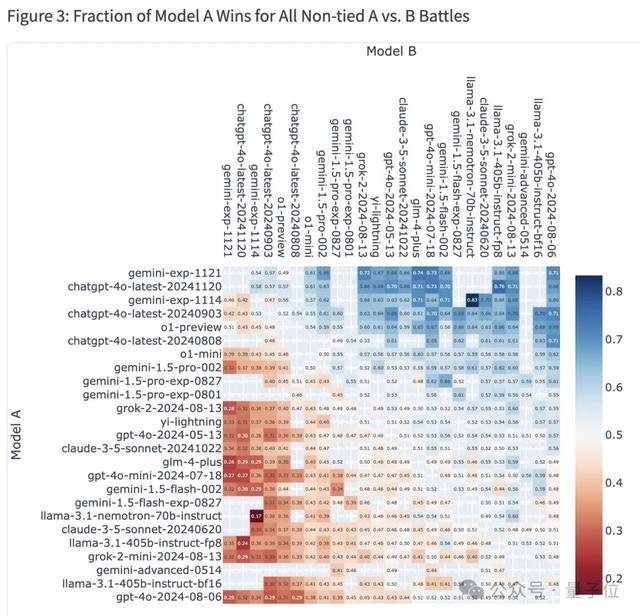

竞技场中的实际胜率如下。

现在也能直接上手体验。

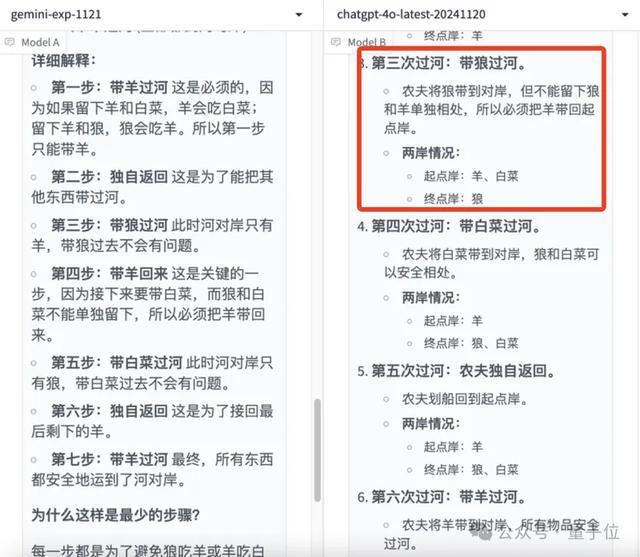

比如针对同一张漫画,让Gemini-Exp-1121和GPT-4o-lastest-1120给出理解。

Gemini-Exp-1121的回答更加全面且详细,并且善用小标题、重点加粗。

新版4o的回复就比较简短和笼统。

在经典的动物过河逻辑推理题上,Gemini-Exp-1121回答完全正确,新版4o出现了一些失误,把第三次过河和第四次过河合并了,因此回答有误。

问题:农夫需要把狼、羊和白菜都带过河,但每次只能带一样物品,而且狼和羊不能单独相处,羊和白菜也不能单独相处,问农夫该如何过河。

One More Thing

值得一提的是,OpenAI这边也有新消息。

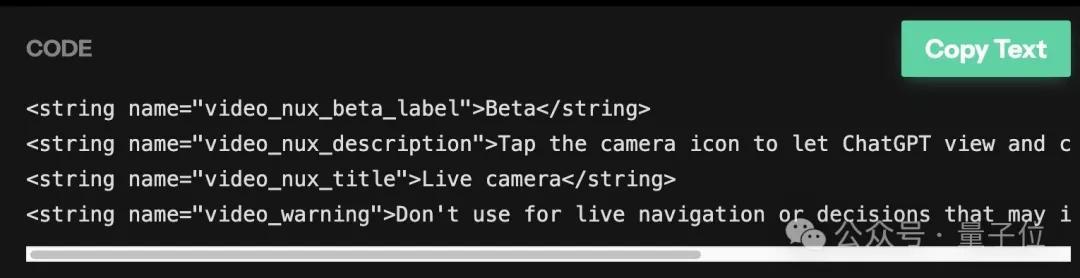

有人在ChatGPT最新测试版本中首次发现了“实时摄像”(Live Camera)视频功能的代码。

它具体包括实时录像、实时处理、语音模式集成以及视觉识别能力。

在高级语音模式推出时,一些用户有体验到这一能力。

这意味着OpenAI已经做好了上线这一功能的准备。

另一边谷歌也演示过类似的demo,还没上线。按照OpenAI的调性,很可能会抢在谷歌前全量铺开。

或许等到明年,和Chatbot的主要交流方式,就要从文字对话转为语音和agent了。Live Camera可能就是开始,你觉得呢?